1. OpenDev — 터미널 기반 오픈소스 코딩 에이전트

OpenDev는 개발자가 실제로 작업하는 터미널 환경 중심의 코딩 에이전트로, 기존 IDE 기반 코딩 어시스턴트와 접근 방식이 다릅니다.

🔍 핵심 기여

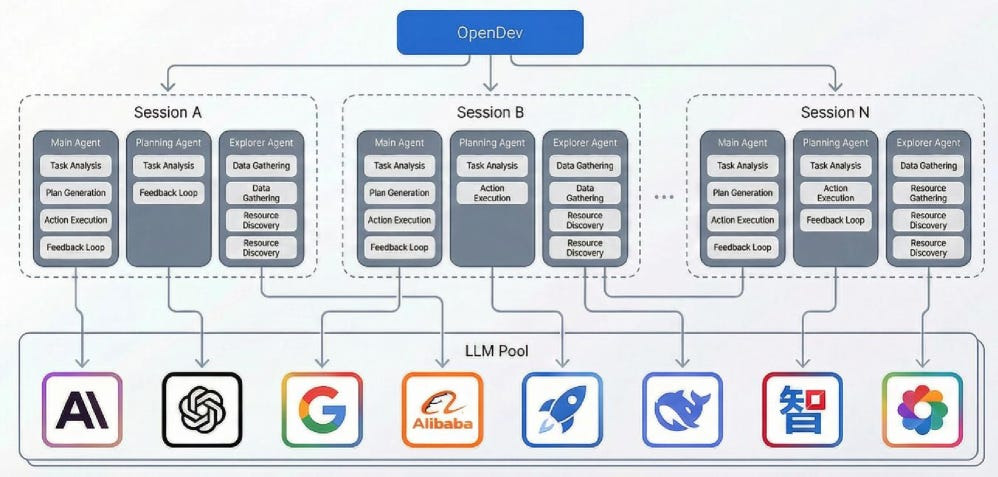

- 듀얼 에이전트 구조

- 하나는 계획(Planning), 다른 하나는 실행(Execution)을 담당하는 분리형 시스템.

- 각 작업은 세션 단위로 진행되며, 세션 내에는 여러 전문화된 서브 에이전트가 존재해 서로 다른 LLM에 연결될 수 있음.

- 이는 “작업에 따라 적합한 모델을 다르게 선택하는” 세밀한 라우팅을 가능하게 함.

- 고급 컨텍스트 컴팩션(Context Compaction)

- 에이전트가 작동하며 쌓이는 방대한 정보를 자동으로 정리해 컨텍스트 폭주(context bloat)를 방지.

- 필요 없는 오래된 내용을 지능적으로 줄이고 관련성 높은 정보를 유지함.

- 자동화된 프로젝트 메모리

- 프로젝트 특화 지식을 스스로 축적하고, 필요한 시점에 리마인더를 제공.

- 장기 작업에서 필수적인 “컨텍스트 유지 문제”를 해결.

- 4계층 구조

- 추론(Reasoning), 컨텍스트 엔지니어링, 툴링, 지속성(Persistence)으로 분리된 계층.

- 계층별 독립적 발전이 가능해 확장성이 뛰어남.

2. AutoHarness — LLM의 불법 행동 방지 자동 코드 하네스 생성

Google DeepMind의 AutoHarness는 LLM이 환경 규칙을 어기지 않도록 자동으로 보호막(harness)을 생성하는 기술입니다.

🔍 왜 필요한가?

- Kaggle GameArena 체스 대회에서 78%의 패배가 전략이 아닌 ‘불법수’ 때문임을 발견.

→ 즉, 규칙 체크만 제대로 해도 성능이 크게 올라갈 수 있음.

🔍 핵심 기여

- 자동 하네스 생성

- 사람이 규칙 엔진을 만드는 대신, LLM이 환경 피드백을 받아 반복적 개선을 통해 스스로 하네스를 생성함.

- 이는 코드 생성+검증 루프를 자동화한 형태.

- 작은 모델이 큰 모델을 능가

- Gemini‑2.5‑Flash + AutoHarness → Gemini‑2.5‑Pro 및 GPT‑5.2‑High보다 우수한 성능.

- 즉 정교한 제약 조건이 모델 크기보다 더 강한 효과를 낸다는 증거.

- 145개 게임에서 불법 행동 0%

- 싱글/멀티플레이 환경 포함.

- 완전한 규칙 준수는 안정성과 신뢰성 측면에서 큰 의미.

3. SkillNet — 대규모 AI 스킬 인프라스트럭처

AI가 매번 처음부터 해결책을 다시 만드는 문제를 해결하기 위해, SkillNet은 스킬을 생성·평가·조직하는 통합 시스템을 제시합니다.

🔍 핵심 기능

- 스킬 온톨로지 기반 구조화

- 코드, 프롬프트, 툴 조합 등 다양한 형태의 스킬을 구조적으로 저장.

- 스킬들이 서로 연결돼 있어, 복합적 스킬 조합 가능.

- 다중 기준 스킬 평가(5D 평가)

- 안전성

- 완전성

- 실행 가능성

- 유지보수성

- 비용 인식

→ 고품질 스킬만 레포지토리에 포함됨.

- 20만 개 이상의 방대한 스킬 저장소

- UI 기반 탐색 도구와 Python API 제공.

- 다양한 도메인에 걸친 스킬 검색・활용 가능.

- 에이전트 성능 개선

- ALFWorld, WebShop 등에서 평균 보상 +40%, 실행 스텝 −30%로 성능 향상.

4. The Spike, the Sparse and the Sink — 트랜스포머 내부 이상 현상 분석

Yann LeCun 팀이 트랜스포머 모델의 두 가지 ‘이상 현상’을 체계적으로 분석합니다.

🌀 Massive Activations(스파이크)

- 특정 토큰에서 극단적으로 높은 채널 활성화가 발생

→ 레이어 전체에서 거의 일정한 표현을 만들어 숨은 파라미터처럼 작동함.

🌀 Attention Sinks(싱크)

- 특정 토큰이 의미와 무관하게 과도한 주목(attention)을 받는 현상.

→ 종종 문장 시작 토큰 등에서 관찰됨.

🔍 핵심 발견

- 두 현상은 Pre-norm 구조 때문에 동시 발생한다는 점을 규명.

- Pre-norm을 제거하면 두 현상이 완전히 분리됨.

- 이는 모델 압축, 양자화, KV 캐시 최적화에서 매우 중요한 통찰.

- 많은 최적화 기술들이 실패하는 숨은 원인을 설명함.

5. KARL — RL 기반 기업용 검색 에이전트

Databricks의 KARL은 여러 종류의 검색 작업에 대해 RL을 적용해 AI 검색 시스템을 훈련하는 프레임워크입니다.

🔍 핵심 특징

- OAPL(Off-policy Actor-Learner) 제안

- 대규모 배치 오프폴리시 RL 기술.

- 트레이너와 추론 엔진 차이로 인한 성능 저하를 해결.

- 다중 도메인 학습

- 엔터티 검색

- 문서 간 정보 통합

- 표형 데이터

- 절차적 추론 등

→ 단일 벤치마크 최적화보다 훨씬 강한 일반화 성능 획득.

- Pareto-optimal 성능

- 비용/품질, 지연/품질 균형에서 Claude 4.6·GPT‑5.2와 비교해 경쟁력 확보.

6. Memex(RL) — 장기 작업을 위한 인덱스 기반 메모리 시스템

복잡한 장기 작업에서 LLM이 기억을 잃어버리는 문제를 해결하는 새로운 메모리 아키텍처입니다.

🔍 핵심 기여

- Indexed Experience Memory

- 전체 기록은 외부 DB에 저장하면서

작업 중에는 압축된 요약 + 인덱스만 유지해 컨텍스트를 작게 유지.

- 전체 기록은 외부 DB에 저장하면서

- RL 기반 메모리 정책 학습

- 언제 요약하고, 무엇을 기록하고, 언제 가져올지를 RL로 최적화.

- 메모리 사용이 전략적으로 결정됨.

- 복잡도 제한 + 성능 향상

- 긴 작업에서도 결정 품질을 유지하면서 계산량을 억제.

- 기존 방식보다 작은 컨텍스트로 더 나은 성능.

7. FlashAttention‑4 — Blackwell GPU 최적화

차세대 NVIDIA Blackwell GPU(B200, GB200)에 맞게 재설계된 새로운 Attention 커널입니다.

🔍 주요 성능

- cuDNN 9.13 대비 최대 1.3×

- Triton 대비 최대 2.7×

- BF16 기반에서 1613 TFLOPs/s, 71% HW 활용률 달성.

🔍 기술적 혁신

- 비대칭 하드웨어 스케일링(텐서코어만 2× 증가)에 맞춘 파이프라인 전면 재설계

- 소프트맥스 재스케일링을 SW로 에뮬레이션

- 큰 타일과 텐서 메모리 활용해 shared memory 트래픽 감소

- Python 기반 CuTe‑DSL 사용 → C++ 대비 20–30× 빠른 컴파일 시간.

8. STRUCTUREDAGENT — 계층적 계획 기반 웹 에이전트

복잡한 웹 작업을 해결하는 새로운 AND/OR 계층 구조 플래너.

🔍 특징

- LLM은 특정 노드 확장/수정 같은 “국소적” 작업에만 사용

- 전체 플래닝 트리는 시스템이 관리해 일관성·구조성을 유지

- 구조적 메모리로 후보 솔루션을 관리하고 제약 충족률 향상

- WebVoyager 등에서 기존 LLM 에이전트보다 높은 성능

- 계획이 명확해 디버깅 및 인간 개입이 쉬움

9. AgentIR — 추론-aware 검색 시스템

AgentIR은 LLM 에이전트의 사전 추론(reasoning traces)을 검색 쿼리와 함께 반영하는 새로운 검색 패러다임입니다.

🔍 핵심 기여

- Reasoning-aware embedding

- 기존 검색기는 LLM의 생각 과정(Chain-of-thought)을 무시하지만,

AgentIR은 이를 함께 임베딩하여 검색 성능을 높임.

- 기존 검색기는 LLM의 생각 과정(Chain-of-thought)을 무시하지만,

- DR-Synth 데이터 생성 기법

- 기존 QA 데이터에서 reasoning-aware 학습 데이터를 자동 생성.

- 성능

- BrowseComp‑Plus에서 4B 모델이 기존 2× 크기 모델보다 높은 정확도(68%).

- BM25 대비 극적 향상.

10. Think Harder or Know More — 루프 구조 + 메모리 뱅크 결합 모델

Transformer 레이어에 학습된 루프(반복)와 메모리 뱅크를 추가한 모델 아키텍처 연구.

🔍 주요 발견

- 레이어 반복(looping) → 수학적 추론에 효과

- 메모리 뱅크 → 상식적 과제에서 성능 회복

- 둘을 결합하면 3배 레이어 모델과 비슷한 FLOPs로 더 좋은 성능

- 내부 분석 결과,

- 초기 레이어: 루프 적게, 메모리 거의 안 씀

- 후반 레이어: 루프 증가, 메모리 활용 극대화 → 레이어별 역할이 자연스럽게 분화됨.

'AI > NLP' 카테고리의 다른 글

| NLP paper review (4/6~4/12) (0) | 2026.04.13 |

|---|---|

| NLP paper review (3/30~4/5) (0) | 2026.04.06 |

| NLP paper review (3/23~3/29) (0) | 2026.03.30 |

| NLP paper review (3/1~3/8) (0) | 2026.03.10 |