📌 이번 주 한눈에 보기

- 주제 전반: 에이전트형 AI, 자기개선 시스템, 멀티에이전트 협업, 장기계획·강화학습, 트랜스포머 아키텍처 개선

- 트렌드 요약: 단일 모델 성능 향상 → 구조·사회적·워크플로우 차원의 지능 확장으로 초점 이동

🥇 주요 논문 요약

1. Hyperagents

- 핵심 아이디어: 태스크 에이전트와 메타 에이전트를 하나의 자기수정 가능한 프로그램으로 통합

- 의의: “어떻게 개선할지를 개선”하는 메타인지적 자기개선 가능

- 결과: 코딩을 넘어 도메인 일반적 자기개선에서 기존 방법 대비 우수한 성능

2. Agentic AI and the Next Intelligence Explosion (Google)

- 주장: 다음 지능 폭발은 개인(superintelligence)이 아니라 사회적·집단적 지능

- 포인트

- 모델 내부의 society of thought가 추론 성능의 핵심

- RLHF 중심의 개별 정렬 → 제도·조직 단위 정렬로 전환 필요

- 인간–AI 하이브리드(centaur) 형태의 집단 행위자 등장

3. ARC-AGI-3 (Chollet)

- 새 벤치마크: 상호작용·탐색·계획이 필요한 턴 기반 추상 환경

- 충격적인 결과:

- 인간: 100% 해결

- 최신 AI: 1% 미만

- 의미: 현재 AI는 완전히 새로운 문제에 대한 적응적 효율성이 크게 부족

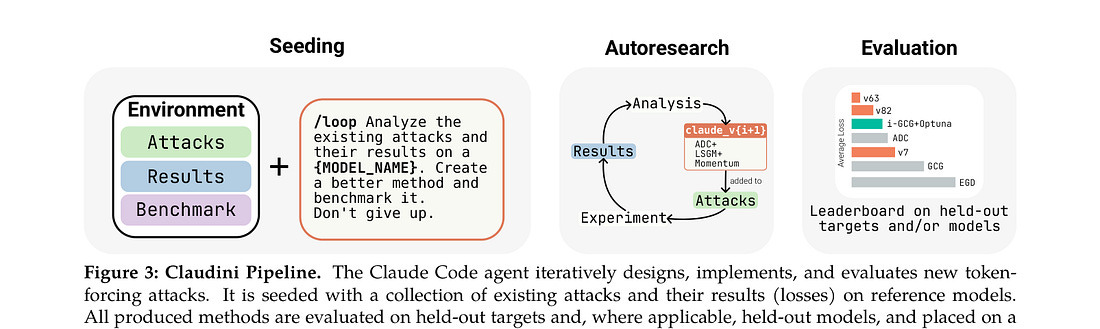

4. Claudini

- 내용: Claude Code 기반 에이전트가 신규 LLM 공격 알고리즘을 자동 발견

- 성과: 기존 30+ 공격 기법을 능가, 타 모델에도 강한 전이 성능

- 중요성: 안전·레드팀 연구의 자동화 가능성 입증 (오픈소스 공개)

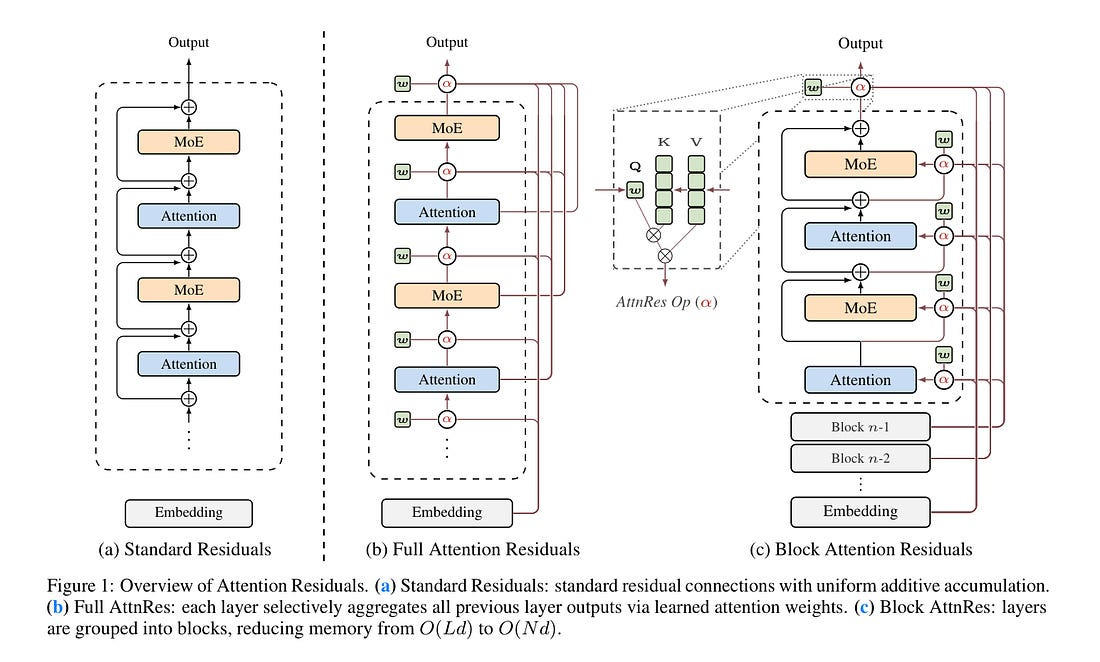

5. Attention Residuals (Moonshot AI)

- 문제의식: PreNorm 잔차가 깊어질수록 신호 희석

- 해결: 고정 잔차 대신 레이어 간 가중치를 attention으로 선택

- 결과: 안정적인 스케일링과 전 과제 성능 향상

6. MemCollab

- 아이디어: 서로 다른 에이전트의 추론 궤적을 대비해 에이전트-불가지(memory) 구축

- 효과: 수학·코드 생성에서 정확도 + 효율 동시 개선

- 포인트: 메모리를 모델 간 공유 가능하게 만듦

7. Composer 2 (Cursor)

- 에이전트형 소프트웨어 엔지니어링 전용 모델

- 학습 방식:

- 지속 사전학습 → 2) 대규모 RL

- 성과: SWE-bench, Terminal-Bench에서 프론티어급 성능

8. PivotRL (NVIDIA)

- 방법: SFT 궤적 중 중요 결정 지점(pivot)에만 RL 신호 집중

- 장점: RL과 유사 성능을 4배 적은 롤아웃으로 달성

- 적용: Nemotron-3-Super-120B에 실제 사용 중

9. LLM Agent Workflow Optimization (IBM Survey)

- 내용: 에이전트 워크플로우를 계산 그래프로 보는 종합 정리

- 가치: 실제 서비스용 에이전트 설계 시 구조 자체가 성능의 핵심임을 강조

10. BIGMAS

- 구조: 작업별로 동적으로 설계되는 그래프형 멀티에이전트

- 영감: 인지과학의 Global Workspace Theory

- 결과: 복잡한 추론에서 기존 멀티에이전트 대비 일관된 성능 향

'AI > NLP' 카테고리의 다른 글

| NLP paper review (4/6~4/12) (0) | 2026.04.13 |

|---|---|

| NLP paper review (3/30~4/5) (0) | 2026.04.06 |

| NLP paper review (3/9~3/15) (0) | 2026.03.16 |

| NLP paper review (3/1~3/8) (0) | 2026.03.10 |